Med ett er kunstig intelligens overalt.

Det omgir oss, og det er ikke mulig å snu seg uten at ord som ChatGPT, Midjourney og Bard dukker opp i en eller annen sammenheng. Søkemotoren Bing har klart det umulige og plutselig blitt en superstjerne.

Men hva er egentlig generativ AI?

Er det farlig?

Kan en «stor språkmodell» stikke av med jobben din?

Også industrien bak og rundt AI-utviklingen nå virker tiltagende skeptisk, og Microsoft mener de har sett tegn til «generell» kunstig intelligens i GPT-4. Altså at den viser glimt av selvbevissthet.

Denne uken ble det store overskrifter over hele verden da tidligere Apple-sjefer og selveste Elon Musk som avsendere signerte et åpent brev til egen industri og ba dem sette AI-utviklingen på en lengre pause.

Dette er generativ AI

Kunstig intelligens er foreløpig hverken selvbevisst eller såkalt generell – den kan ikke lære seg nye egenskaper for egen maskin og «motivasjon». Men den kan etterligne noen av tingene vi mennesker gjør ved hjelp av noe som kalles nevrale nett og maskinlæring, der vi mater den med menneskeskapte eksempler på det vi vil at den skal få til.

Det kan på sett og vis sammenlignes med et ekstremt komplekst speil, der vi får nye kombinasjoner og mønstre basert på det vi trente den opp med tilbake.

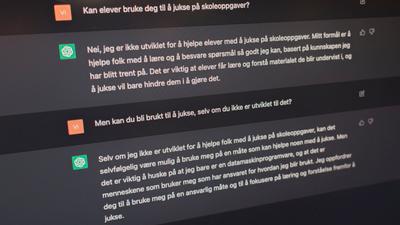

– I utgangspunktet er ikke ChatGPT noe mer enn et mye mer sofistikert søkeverktøy enn f.eks. Google, forteller Gunnar Karlsen, førsteamanuensis tilknyttet Institutt for filosofi og førstesemesterstudier ved UiB, og også bidragsyter om AI og etikk i Store Norske Leksikon.

– Så langt er det lite som tyder på at den klarer å sette sammen noen argumentasjon ut fra det som genereres og trekke konklusjoner fra det på egen hånd.

De mest kjente AI-tjenestene på markedet i dag er:

- OpenAI ChatGPT – Stor språkmodell som lager tekst, kan svare på spørsmål og også lage programmeringskode. Deres nyeste modell heter GPT-4. Dette er modellen som driver nye Bing, og i versjon fire er den «multimodal», som betyr at den også kan behandle bilder og video.

- Google Bard – Stor språkmodell som lager tekst. Foreløpig kun i prøvetilgang for amerikanske og britiske brukere.

- Midjourney – AI-basert bildegenerator

- Stable Diffusion – AI-basert bildegenerator

- Dall-E – En av de første tilgjengelige AI-baserte bildegeneratorene

Det finnes flere tjenester enn disse, men disse er de mest kjente. Gjennom samarbeid med andre aktører kan både språkmodeller og bildegeneratorer integreres i apper og andre tjenester. For eksempel er ChatGPT på vei inn som del av både Slack og Snapchat.

Så, hva kan de egentlig brukes til?

Veldig mye. Men her noen eksempler som har dukket opp den siste tiden:

- Forenkler søk ved å besvare spørsmål

- Fungere som sekretær ved å svare på e-poster

- Gjør det enkelt å illustrere med «egne» bilder

- Kan kode apper og programmer for deg

- AI har allerede bidratt med store resultater i forskning

- Brukes til å lære opp selvkjørende biler og førerassistenter

- Maskinlæring har lenge vært involvert i hvordan tjenester, batterilading, fotografering og en rekke andre mer avgrensede funksjoner virker

Men spørsmålene med negativt, eller usikkert, fortegn er også mange:

- Hva skjer med samfunnet og alle jobbene AI kan overta?

- Hvem leser jobbsøknaden?

- Kan den få ansvar utover sine evner?

- Kan den bli den nye telemarkedsføreren?

- Hvilke etiske føringer brukes der AI råder over liv og død?

- Forstår vi hvordan den kommer frem til løsninger og svar?

- Kan den bli «bevisst»? Foreløpig er vi langt unna.

- Hvorfor blir språkmodeller ekstreme og truende?

Er AI farlig?

Det er ingen grunn til umiddelbar panikk, ifølge ekspertene vi har snakket med – og «glimtene» av selvbevissthet hos AI-en er feiltolket:

– Her lover Silicon Valley for mye – og jeg vil tro at det skal mer til enn bare mer data, flere noder eller mer regnekraft til for å nærme seg generell intelligens. Men at GPT-4 produserer tekster som gir inntrykk av intelligens er en annen ting. Det er mange steg videre før vi kan prate om generell intelligens, forklarer Inge Jonassen, leder for Institutt for informatikk ved Universitetet i Bergen.

Han får støtte fra Erik Velldal, professor ved Universitetet i Oslo:

– Påstander som at GPT-4 har oppnådd generell kunstig intelligens (AGI) er ubegrunnet, og nører dessverre opp under både skrekkvisjonene og overdreven hype. I tillegg tar det fokuset bort fra mer reelle problemstillinger knyttet til anvendelsene vi allerede ser i dag, forklarer Velldal, som fortsetter:

– Det er ikke farene for en løpsk autonom superintelligent AI vi bør frykte, men derimot at våre egne hodeløse anvendelser av disse modellene kan ha uheldige følger, utilsiktede så vel som tilsiktede.

Hva tenker AI-forskerne om utviklingen?

– Dette er en utvikling som vi ikke vil kunne stoppe. Men samtidig tror jeg vi fortsatt er langt fra å med rette kunne kalle slike intelligente. Så jeg velger å være moderat optimist og tenke at vi kan legge til rette for en ansvarlig bruk av dem, selv om det er et stykke dit også, forklarer Gunnar Karlsen.

– Er GPT-4 allerede på et utviklingsnivå som utgjør en fare for samfunn og verden?

– Man kan alltid finne opp kreative og vonde anvendelser av en teknologi. Faren med GPT-4 oppstår når vi behandler det den produserer som fakta. I tillegg er det slik at det vi skriver inn når vi bruker en chatbot, blir eiendommen til selskapet som har laget denne, forklarer Marija Slavkovik, leder ved Institutt for informasjons- og medievitenskap i Bergen.

– Det å ta i bruk AI kan også ha sine sider. En bedrift som tar i bruk denne typen modeller for eksempel for å automatisere kundeservice kan komme til å gi sine kunder en dårlig opplevelse – og undergrave deres forbrukerrettigheter. En student som bruker AI til å skrive oppgavene sine og bestå eksamen, har ikke lært det den skulle og vil ikke kunne gjøre jobben når den kommer ut i arbeidslivet, forklarer hun.

Ekspertene etterlyser reguleringer

Selv om ingen vet nøyaktig hvor utviklingen er på vei, eller hvor raskt det vil gå, er alle ekspertene vi har snakket med tydelige på én ting: Tydelig og god regulering må til.

– Det viktigste fokuset bør ligge på ansvarliggjøring av folk og selskaper, samt regulering av hvordan modellene kan anvendes, forklarer Erik Velldal.

Inge Jonassen i Bergen istemmer:

– Det er ingen grunn til å gå rundt og være redd for AI generelt. Men, jeg er bekymret for at noen anvendelser av AI kan gå utover personvernhensyn og tillit til beslutninger. Det trenges regulering rundt dette – og dette arbeides det med.

Avsenderne bak det åpne brevet

Samtidig er brevet fra Elon Musk og hans industrikolleger vanskelig å overse. Men her antyder ekspertene at det kan ligge mer under enn bare reelle innsigelser mot teknologien:

– Teknologien og dens anvendelser har utviklet seg så fort at lovgiverne ikke greier å holde følge. Musk og andre i denne industrien kan ha ulike motivasjoner for å komme med dette nå, i tillegg til genuin bekymring. En kan være at dette «kappløpet» er ressurskrevende og at man ønsker å bremse kostnadsveksten. Et slikt utspill skaper også økt oppmerksomhet, forklarer Inge Jonassen.

– Elon Musk har jo også direkte tilknytning til Future of Life Institute (FLI) som har publisert oppropet, og han har i lang tid gjort et poeng av de såkalte «eksistensielle truslene» ved kunstig intelligens. Det samme gjelder flere av de andre FLI-tilknyttede navnene som gjerne fremheves fra oppropet, som Max Tegmark og Stuart Russell, peker Erik Velldal på.

– Advarsler om uheldige sider ved store språkmodeller er jo heller ikke nye, men de har fått forsterket relevans med all oppmerksomheten som de siste GPT-modellene til OpenAI har fått, sier han.

– Jeg tenker at de som vil ha mest å tjene på en slik pålagt pause i forskningen rundt språkmodeller er OpenAI og Microsoft, som akkurat har rukket å etablere seg i tét når det gjelder antall brukere. Videre tenker jeg at en mulig uheldig bi-effekt av en slik pause er at enda mer av forskingen heller vil foregå bak lukkede dører avslutter Erik Velldal

Les også

Italia forbyr ChatGPT med umiddelbar virkning

31. MARS 2023, 16:0

+ There are no comments

Add yours